About this episode

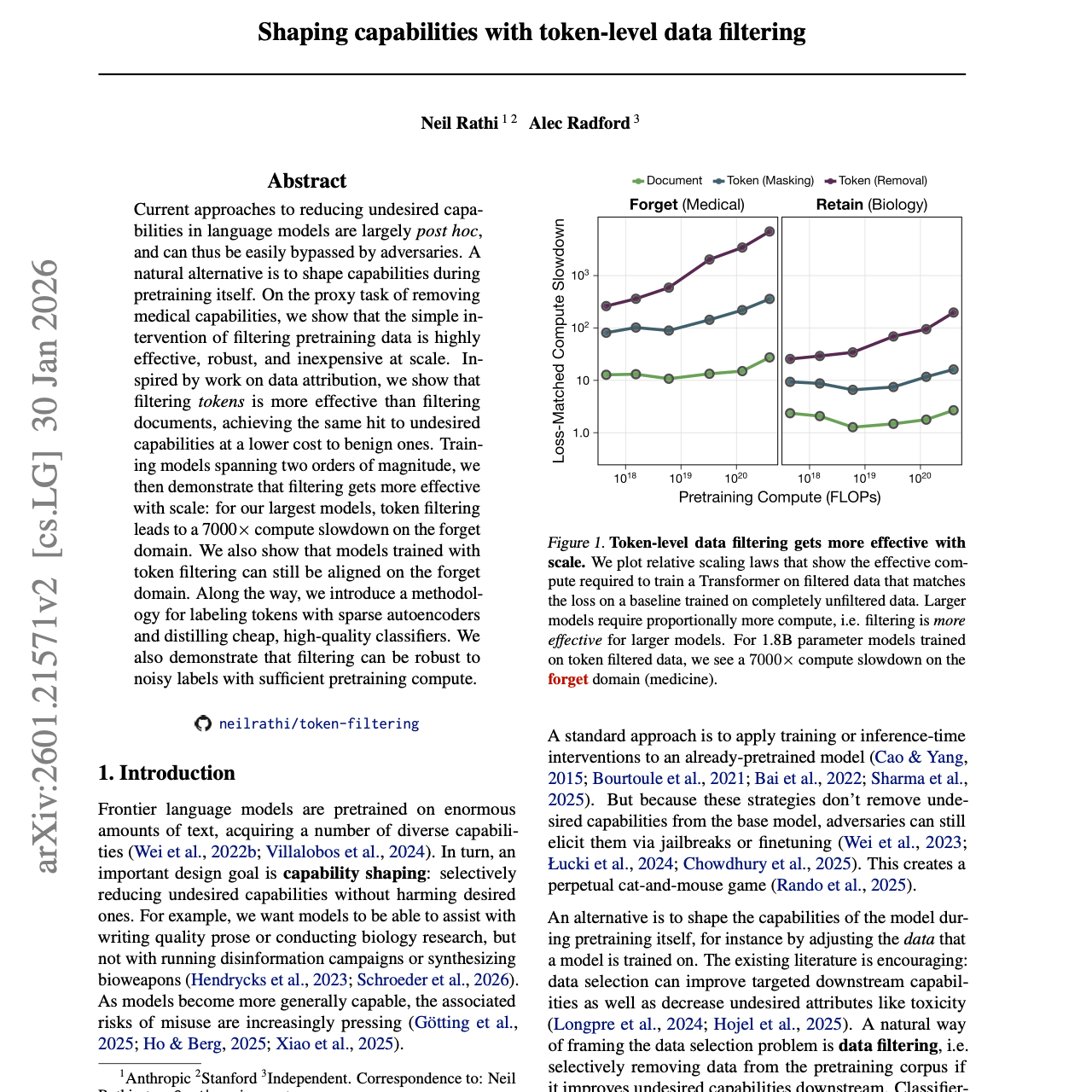

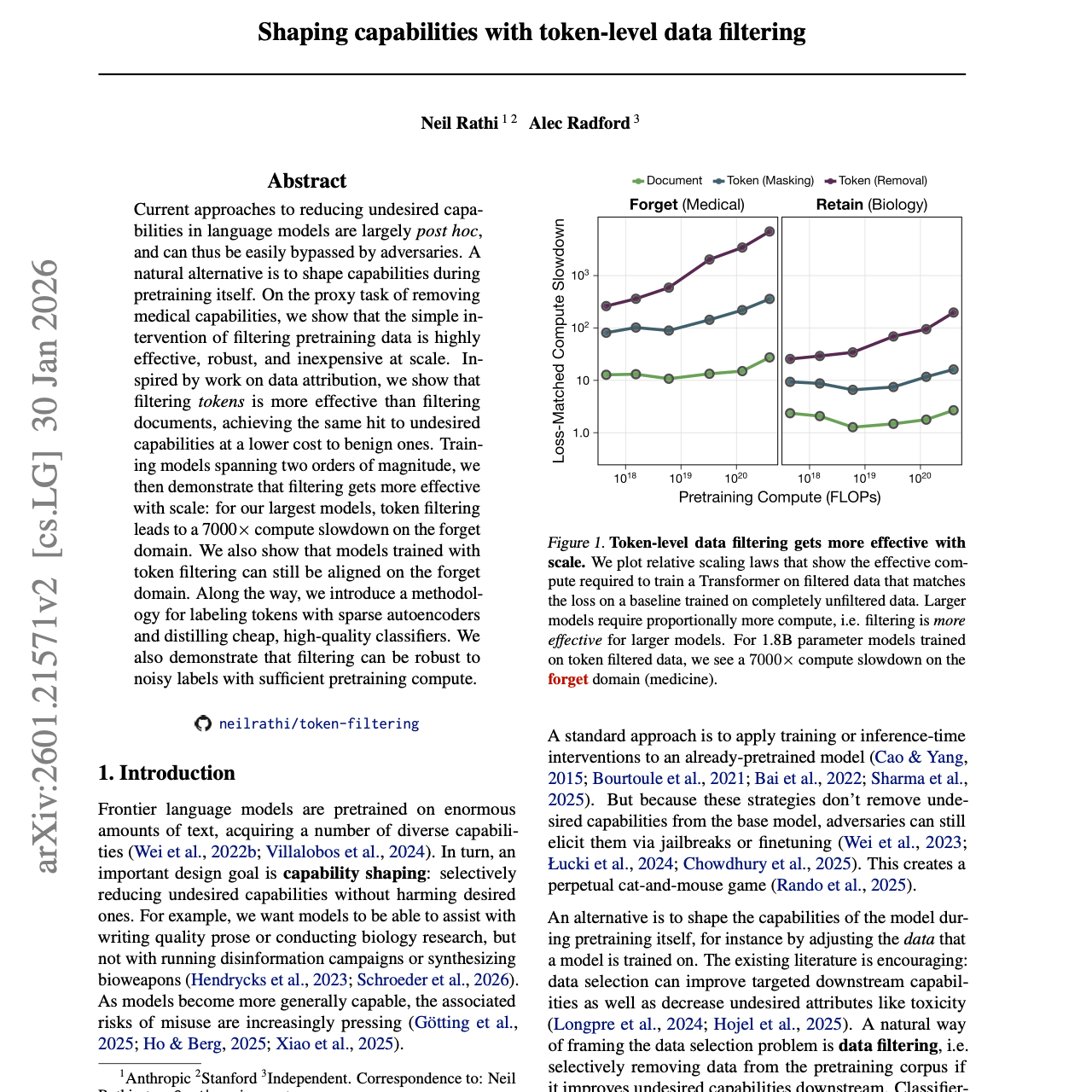

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Shaping capabilities with token-level data filteringSummary当前减少语言模型不良能力的方法大多是事后处理(post hoc)的,因此很容易被对抗者绕过。一种更自然的替代方案是在预训练阶段就对能力进行塑造。以移除医疗相关能力这一代理任务为例,我们表明,仅通过过滤预训练数据这一简单干预,就能够在大规模情况下实现高度有效、稳健且成本低廉的效果。受到数据归因(data attribution)相关研究的启发,我们进一步表明,与过滤文档相比,过滤 token 更为有效:在对不希望出现的能力造成同等抑制效果的同时,对正常能力的影响更小。通过训练跨越两个数量级规模的模型,我们还展示了:随着模型规模增大,过滤策略的效果也会增强。在我们最大的模型上,token 级过滤会使模型在“需要遗忘的领域(forget domain)”上的计算效率降低 7000 倍。我们还表明,通过 token 过滤训练得到的模型,依然可以在该遗忘领域上进行对齐。在这一过程中,我们提出了一种方法:利用稀疏自编码器(sparse autoencoders)对 token 进行标注,并蒸馏出低成本且高质量的分类器。我们还证明,只要预训练计算量足够,过滤方法在存在噪声标签的情况下依然具有鲁棒性。原文链接:https://arxiv.org/abs/2601.21571